|

|

Die Washington Post widmet sich in einem längeren Artikel Fragen des wissenschaftlichen Fehlverhaltens und der Sicht von Studenten auf Grundregeln wissenschaftlichen Arbeitens.

Seit der Diskussion um Donald Trumps Gattin Melania Trump und ihre Rede beim Nominierungsparteitag der Republikaner, die in Teilen von einer Rede von Michelle Obama abgekupfert war, wird in den Vereinigten Staaten Plagiarismus wieder öffentlich diskutiert. Argumentativ erinnern viele Wortmeldungen an die deutsche Diskussion um die Plagiate in den Doktorarbeiten von Bildungsministerin Annette Schavan und Verteidigungsministerin Ursula von der Leyen, obwohl natürlich eine politische Rede nicht mit einer akademischen Qualifizierungsarbeit zu vergleichen ist. Denn selbstverständlich ist von angehenden Promovierten ein anderes Wissen darum zu erwarten, wie man wissenschaftlich sauber arbeitet. Seit der Diskussion um Donald Trumps Gattin Melania Trump und ihre Rede beim Nominierungsparteitag der Republikaner, die in Teilen von einer Rede von Michelle Obama abgekupfert war, wird in den Vereinigten Staaten Plagiarismus wieder öffentlich diskutiert. Argumentativ erinnern viele Wortmeldungen an die deutsche Diskussion um die Plagiate in den Doktorarbeiten von Bildungsministerin Annette Schavan und Verteidigungsministerin Ursula von der Leyen, obwohl natürlich eine politische Rede nicht mit einer akademischen Qualifizierungsarbeit zu vergleichen ist. Denn selbstverständlich ist von angehenden Promovierten ein anderes Wissen darum zu erwarten, wie man wissenschaftlich sauber arbeitet.

Nur die allgemeine Berlusconisierung in der Politik verbindet die Diskussionen wohl. Melania Trumps Rede hat immerhin das Gespräch über betrügerische Energien und Verlogenheit geweckt. Die Kontroverse hat auch einen sehenswerten kreativen Ausschlag der US-Cartoonisten ausgelöst, die mit Spott nicht sparen.

Die WaPo nimmt nun aber Osteuropa in den Blick und schreibt über das Denken und Verhalten bei westlichen Studenten gegenüber Studenten des ehemaligen Ostblocks, wenn es um Plagiieren, Betrügen und Kopieren geht. Es ist schließlich kein deutsches Phänomen, dass nur hierzulande Politiker mit gefälschten Arbeiten auffliegen, wie zwei dreiste Plagiatsfälle in der rumänischen Spitzenpolitik zeigen.

Unabhängig davon, ob man den Argumenten in der WaPo folgen möchte, wonach die Unterschiede bei der Wahrnehmung von Plagiaten und Betrügereien auf das politische System und die verschiedenen Werteordnungen zwischen den einst real existierenden Kapitalismus- und Sozialismus-Varianten zurückzuführen sei, werden eine ganze Reihe an internationalen Studienergebnissen zusammengetragen:

Im Jahr 2002 verglichen Forscher US-amerikanische mit russischen Studenten. 64 Prozent der Russen gaben zu, schon mal betrogen zu haben. Zum Vergleich: Bei den US-Studenten waren es 55 Prozent. Für tschechische Befragte war die Signifikanz einer späteren Studie höher: 44,8 Prozent gegenüber nur 14,1 Prozent bei ihren US-amerikanischen Altersgenossen gaben zu, schon mal von jemandem kopiert oder abgeschrieben zu haben. Bei kroatischen Studenten gaben 20 Prozent an, dass Täuschen bei Prüfungen schon irgendwie statthaft sei, wohingegen britische Studenten das nur zu 7 Prozent so sahen.

Ein weiterer Vergleich zwischen ukrainischen und US-amerikanischen Studenten: Untersucht wurde beispielsweise, wie häufig sie betrogen und wie ihre Sicht auf Mogeleien und Täuschungen ist. Insgesamt gab es auch hier signifikante Unterschiede: Auf einer Art Mogel-Skala von 1 („nie“) bis 5 („täglich“) kamen die US-Studenten auf einen Wert von 1,3, die aus der Ukraine auf 2,38. Gleichzeitig hielten mehr US-Studenten Betrügen auch für ein falsches Verhalten. Man hatte den Studenten sechs verschiedene Arten von Täuschungen vorgegeben, die allesamt von den ukrainischen Studenten als weniger falsch eingestuft wurden als das die US-Studenten einschätzten. Zugleich wurden alle sechs Täuschungsarten auf der ukrainischen Seite auch häufiger angewendet.

Allerdings könnte das auch der Grund für die niedrigeren Werte bei der Angabe über Betrügereien sein:

If U.S. students believe plagiarism and cheating to be worse than students in post-Communist Europe do, they might underreport having done so. Instead of revealing that cheating is more prevalent in Eastern Europe, these studies may simply be telling us only that it’s less embarrassing to admit.

Gründe für das studentische Plagiieren könnten auch natürlich darin liegen, nicht genau zu wissen, was ein Plagiat ist. In den angegebenen Studien spielt die Frage, welches Wissen die Studenten über Grundregeln wissenschaftlichen Arbeitens haben, keine große Rolle, da die abgefragten Arten der Täuschungen sehr einfach als wissentliches Betrügen zu klassifizieren sind.

Es gibt im Artikel auch ein kleines Fallbeispiel zu betrügerischem Verhalten:

Here’s the hypothetical scenario: Two of them cheated during an exam. Student A copied answers from Student B, with B’s consent. Student C reported this to the department.

Wie schätzen wohl russische und US-amerikanische Studenten das Verhalten von A, B und C ein? Nicht gleich hinklicken, sondern erst Vermutungen anstellen, wie neben A und B der „Informant“ C bewertet wird und warum.

Bei der Gelegenheit legen wir nochmal unser Fallbeispiel über Betrug und Plagiat ans Herz.

Bildlizenz: CC BY-ND 2.0, disneyabc.

Rainer Rehak & Stefan Ullrich

Tim kann man wohl landläufig als ,,politisch interessierten Techie“ bezeichnen. Er studierte technische Informatik an der Hochschule in seiner Heimatstadt und verbrachte auch privat viel Zeit am Gerät. Nach einem Kurs zu IT-Sicherheit hatte eine Dozentin ihn auf einen großen jährlichen ,,Hackerkongress“ hingewiesen und prompt war er ohne viel nachzudenken einfach so mit einem Kommilitonen hingefahren.

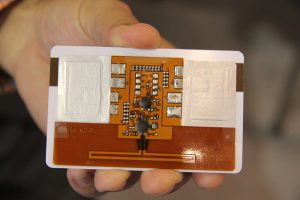

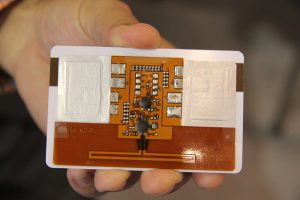

Er besuchte allerlei interessante, verstörende und skurrile Vorträge. Ein Vortrag hatte ihn besonders beeindruckt. Es ging um einen Hack, wobei hunderttausende Passwörter veröffentlicht worden waren. Da bauten die besten Techniker und Technikerinnen die sichersten Computersysteme, die Tim jemals gesehen hatte und die Leute verwendeten ,,12345“, ,,password“ oder gar ,,changeme“ um ihre Daten zu schützen. Das war für ihn unfassbar, aber traurige Realität. An diesem Abend besuchte er einen Workshop zu funkbasierten Smartcards, dabei ging es um das Auslesen, Analysieren und überhaupt Verstehen dieser bald allgegenwärtigen Minisysteme. Die Workshopleiterin namens Juliane beantwortete alle seine Fragen und war selbst nachwie vor begeistert von dieser Technik.

Cartes 2012 – CC BY-NC Pierre Metivier Gegen Ende des Workshops fiel ihm ein, dass er ja die so genannte ,,Multikarte“ seiner Hochschule dabei hatte. Wie zu erwarten war, sendete die Karte nur eine ID undwartete auf eine irgendwie geartete Authentifizierung, bei willkürlichen Eingaben folgte wenig überraschend Kauderwelsch. Er probierte alles Mögliche aus, was er so in seinenVorlesungen gelernt hatte, aber nichts klärte sich. Als die letzte Workshopteilnehmerin gegangen war, kam Juliane zu ihm und sie diskutierten über die vorliegende Situation. BeimHerumflachsen über Sicherheitsproblematiken und -fallstricke war es schließlich Juliane, die ihn an den Vortrag des Hackerkongresses erinnerte. Tim legte seine ,,Multikarte“ wieder auf das Lesegerät, aktivierte die einfachste aller Authentifizierungsarten und gab als Passwort den Hersteller-Standard ,,changeme“ ein – bingo! Nun gab die Karte bereitwillig Auskunft über Bezahlvorgänge, Aufladedaten und auch über den Kontostand. Scheinbar war die günstigste aller Lösungen ohne Schattenkonten oder andere Sicherungsmaßnahmen verwendet worden, ein sicherheitstechnischer Alptraum!

Er rief seinen Kommilitonen herbei, der auch so eine Karte verwendete, und auch dort waren die Informationen mit diesem Passwort einfach auslesbar, kopierbar und änderbar. Den ganzen Abend dachte er darüber nach,welche Systeme um ihn herum wohl ebenso unsicher waren. Türschlösser, EC-Karten, Herzschrittmacher, Kinderspielzeug, Spielzeugdrohnen – das Internet der angreifbaren Dinge. Sollte er den ,,Fehler“ nun der Herstellerfirma melden, sich bei der Hochschule beschweren oder erst mal ein paar kostenlose Essen vertilgen? Dann dachte er daran, dass man mit der Multicard auch Kopien und Scans in der Bibliothek bezahlen konnte. Die Digitalisierung eines Buches kostet um die 30 Euro, das würde sich durchaus lohnen.

Je mehr Tim über die Möglichkeiten nachdachte, desto eher kamen ihm auch soziale Projekte in den Sinn. Im Winter könnte man Schlüsselkarten an umliegende Obdachlose verteilen oder Mensakarten an weniger bemittelte Kommilitonen. Aber wie würden die Angesprochenen reagieren? Er war unentschlossen und fragte im privaten Forum seiner Studienkollegen nach Handlungsoptionen.

Am Morgen des nächsten Tage hatte er ein paar neue E-Mails im Postfach. Sein Kommilitone berichtete in einer E-Mail von vielen interessanten Gesprächen über diese Entdeckung, die er mit allerlei Leutenauch inanderen Foren geführt hatte, ein paar Spam-Mails waren dabei und dann eine E-Mail mit merkwürdigem Betreff und Absender. Da schrieb jemand, dass er großes Interesse daran hatte, dass dieser Fehler nicht behoben und auf gar keinen Fall an die Öffentlichkeit kommen sollte. Dieses Schweigen würde auch großzügig bezahlt werden. Zusätzlich war die Person auch an weiteren ,,Fehlern“ des Abrechnungskartensystems interessiert. Bedroht kam er sich nicht vor, aber seltsam war das doch. Er überlegte, was das nun eigentlich bedeutete.

Fragen

- Sollte Tim seinen Mitstudierenden aus wirtschaftlich schwachen Familien helfen, indem er das Guthaben ihrer Mensakarte auflädt?

- Welche Verantwortung trägt die Betreiberfirma der Mensa, die ein solches unsicheres Passwort eingesetzt hat?

- Macht es einen moralischen Unterschied, ob der Unbekannte sich als ein Hacktivist für sozial minderbemittelte herausstellt oder als Mitarbeiter der Herstellerfirma oder gar als Geheimdienstzuarbeiter?

- Welche Anreize setzt es, wenn ein Akteur Geld für Sicherheitslücken bietet?

- Machen sich die Mitglieder des privaten Forums mitschuldig, wenn sie von einer solchen Geschichte erfahren, aber nichts unternehmen?

- Hätten die Vortragenden des ,,Hackerkongresses“ nicht ihrerseits die Sicherheitslücken bereits dem Hersteller melden und somit beseitigen können?

- Würde es einen (moralischen) Unterschied machen, wenn die Schwachstelle nur durch aufwändige Verfahren (Ablösen des Chips, Betrachtung unter Elektronenmikroskop etc.) auffindbar gewesen wäre?

Erschienen im Informatik Spektrum 39(2), 2016, S. 166–167.

Thomas Kittel, Carsten Trinitis

A Bavarian company that develops camera systems and software for video surveillance in public places is expanding its product’s functionality to include the precise localization of various sounds (for example, gunshots) using multiple microphones. A record is made of all the data captured by the microphones.

The data collected is of such high quality that individual conversations can be easily extracted. So now it’s possible in real-time to use facial recognition posted in a Facebook search to identify who is in a surveillance video and to extract what that person is saying automatically.

Even though company employees are fully aware of the implications for the privacy of people being observed, they consider it an essential crime-fighting tool because they believe it will deter would-be criminals who come within viewing range of the cameras.

So that’s why they’re marketing the product as a video security system.

As an employee, Bernd knows that this new technology not only stores people’s movement profiles but also saves their conversations for thirty days. But he simply can’t imagine why anyone would abuse this data for nefarious purposes. Besides, he thinks the company is so small that no one would be interested in the data they collect anyway.

Plus, the budget for the system is limited, so he decides to set up the servers and databanks for storing all this sensitive data himself without knowing enough about data security to do this.

After an eighteen-month test phase at two centrally located public squares and in the city’s public transportation system, the audio-visual surveillance system is slated for city-wide installation.

Politicians and business executives speak in terms of a crucial system that’s already reduced the city’s crime rate and can now reduce it even further with this new technology (“Our success rate speaks for itself!”). Many residents were initially skeptical because it meant that their every move would be caught on tape, and now even their conversations would be recorded (and saved). Still, most of them quickly got used to it and now feel comfortable (and safe) with the system.

One balmy summer evening after the test period had run, two foreign correspondents ride a bus through the city center as tourists. Through the bus window, they witness a man stumble backward out of a bar and into the street. Behind him, two other stockily built individuals follow and attack the man lying on the ground. The journalists also watch as bystanders retreat rather than intervene and stand idly by at a safe distance as the offenders continue to beat the victim bloody as he is lying on the ground. Peter is among the locals passing by: he just assumes that the perpetrators will be easily identified and apprehended with the help of the audio and video recordings, so he figures there’s no need to risk his own life by getting involved.

Meanwhile, the out-of-town journalists urge the driver to call in an emergency and stop so the bus they can get out and intervene. But all the bus driver has to say is, “Don’t worry about it; that’s all on video. They’ll catch the perpetrators.” One of the passengers screams at them, “Do you want to get yourselves killed, or what? They won’t stop with you!” As they drive by, they see the victim’s motionless body lying in his blood.

After the incident, police officer Karl was tasked with reviewing the video data to ascertain precisely what happened that evening and who the perpetrators were. The officer first questioned some of the passersby, Peter included, whose contact information had been obtained through a radio cell inquiry and who were automatically summoned. Most witnesses, though, only vaguely recalled the incident. They’ve already suppressed it from memory, assuming that what happened was captured on video anyway. So Karl requests access to audio and video recordings from the crime scene. But about two weeks later, he learns that the cameras for that location were inoperable when the crime was committed. However, from the audio recordings, he knows that the perpetrators had been threatening the victim for quite some time inside the bar. Because there’s no video footage, though, the investigation hits a dead-end.

Upon their return home, the two journalists pen an article about civic courage in Germany—using the bus incident as a case in point. It’s published in the print edition of a major newspaper and on the paper’s website. A debate about the incident quickly ensues on social media, prompting traditional news outlets to delve more deeply into the matter. It becomes apparent that perceived security leads to widespread insecurity and indifference since people no longer feel any sense of personal responsibility. Closer examination reveals that crime hasn’t diminished; it’s merely moved from the significant public squares to other less highly surveilled places. Crime in some of these different areas has gotten so bad that people are afraid even to visit these neighborhoods. Even the police struggle to gain control over these new crime hotspots.

As a result, the developers of the surveillance system are suddenly subject to widespread media scrutiny. However, the developers are becoming increasingly aware of the drawbacks to deploying this technology: The system that was intended to make the city safer has led to the death of at least one individual. Bernd doubts how the cameras just happened to have failed, so he steals a second look at the database log files and notices that someone has accessed them multiple times. Could it be that someone deliberately deleted the data? If so, that would mean that there was a flaw in his design of the databank and corresponding access privileges. So he decides to keep the discovery to himself.

Secretly, he’s hoping that all the media scrutiny will soon subside.

Questions:

- Should technology be seen as an all-encompassing panacea for solving all society’s problems?

- How should the sheer volume of data collected from the population under surveillance be handled?

- What risks are involved?

- What actions should Bernd take as a result of his discovery?

- Should he invest his private time in the project even though there is no budget for it? Should he get out ahead of the story and contact the press himself?

- Who should have access to the collected data? What are the (legal) justifications to determine who has access?

- Have the passersby exposed themselves to legal liability for failing to render aid?

- Has responsibility shifted from the civic arena to the authorities in charge of surveillance?

- Can anyone ever be called to account for anything once everything has been left to technology?

Erschienen im Informatik Spektrum 39 (1), 2016, S. 82-84

— Translated from German by Lillian M. Banks

openDemocracy – cyberspace – CC-BY-SA In zahlreichen netzpolitischen Konferenzen, Dialogen und Diskussionen wird derzeit die Thematik „neue Regeln für den Cyberspace“ angegangen. Es geht dort den Umgang mit Beleidigung, Immaterialgüterrechten bis hin zum „Cyberkrieg im Netz“. Dabei zeugt die Begriffswahl „Cyberspace“ von grundsätzlichem Unverständnis der Materie und sie erschwert fruchtbare Debatten sogar noch.

Der Begriff „Cyberspace“ tauchte erstmals in den 1980er Jahren in der Science-Fiction-Literatur auf und wurde in den 1990ern – zur Zeit der Kommerzialisierung des Internet – auch darüber hinaus geläufig. Gemeint war immer ein von der echten Welt verschiedener, virtueller Raum, in dem andere Regeln galten. Mit Peter Steiner gesprochen: „On the internet, nobody knows you’re a dog“. Nun, zwanzig Jahre danach, bemerken wir jedoch, dass es diese zweite Welt gar nicht gibt, sondern dass das Digitale einfach Teil unserer normalen Welt wurde. Niemand ist mehr „online“ oder „offline“, weil auch unsere mobilen Geräte nun per default verbunden, ja ohne Netzverbindung teilweise völlig nutzlos sind. Weder die elektronisch übermittelte Steuererklärung noch die digitalen Videoüberwachungssysteme oder soziale Netzwerke sind auch nur ansatzweise virtuell. Es geht immer um reale Aktion und reale Konsequenz. Menschen werden wegen ihrer Äußerungen in sozialen Netzwerken auf echte „No-Fly“-Listen gesetzt; Personen bekommen echte Hausdurchsuchungen, weil sie bestimmte Daten veröffentlicht haben; wenn wir online etwas bestellen, kommt es tatsächlich zu uns in den Briefkasten; neue Autos sind immer mit dem Netz verbunden und das Internet bringt uns Filme, Telefon und Fernsehen ins Haus. Auch die Kommunikationsinfrastruktur selbst ist keineswegs virtuell: Router, Kabel, Netzknoten, Server – die Komponenten des Internet sind physisch existent und territorial verortbar. Von einem rechts- und regierungsfreien „Cyberspace“ kann also keine Rede sein, denn niemand lebt, arbeitet, kommuniziert oder leidet in diesem Cyberspace.

Wir stehen ohne Zweifel vor riesigen Herausforderungen, die Digitalisierung der Gesellschaft vernünftig zu gestalten, vorhandene Regelungen der vordigitalen Zeit zu aktualisieren und nötigenfalls zu erweitern. Aber Beleidigung, Erpressung, Datenklau und Spionage finden nicht im „Cyberspace“ statt, sondern sie werden von realen Tätern an realen Opfern begangen. Zuletzt muss darauf hingewiesen werden, dass in der öffentlichen Debatte meist nur dann von „Cyber-“ gesprochen wird, wenn es um undefinierte Gefahren geht (Cyberkriminalität, Cyberabwehrzentrum, Cyberkrieg). Positiv spricht man dagegen von der „digitalen Agenda“, „Onlinehandel“, „Internet Governance“ oder „e-government“, denn da geht es um spezifische informationstechnische Aspekte unserer echten vernetzten Welt, nicht um ein (fernes) Land. Insgesamt ergibt sich, dass die Cyberspacemetapher nicht hilfreich ist, wenn man über konkrete Gestaltung sprechen will – ganz im Gegenteil, denn sie blendet reale Machtverhältnisse aus und verhindert so Chancen echter Veränderung.

Folglich gilt es, den Fokus auf die prägenden Akteure zu richten und darauf, welche Regeln sie befolgen. Wenn mächtige Geheimdienste ganz genau wissen, wo sich jedes ans Internet angeschlossene Gerät befindet und zu welcher Person es gehört, so ist das politisch gewollt und kein Versehen. Wenn globale Konzerne Daten global verknüpfen, so ist das oftmals rechtlich erlaubt oder wird bewusst nicht geahndet. Wenn westliche Hersteller Überwachungssoftware an beliebige Drittstaaten liefern, so geschieht das vielfach nicht ungeregelt, sondern von Exportgesetzen gedeckt. Die aktuelle Situation entstand folglich nicht aus zufälliger „Wildwest“-Regellosigkeit, sondern aus den durchgesetzten, handfesten Interessen der jeweiligen Profiteure, egal ob es um Kriegsaktivitäten oder Datenhandel geht. Möchte man also ernsthaft über die Gestaltung der digitalen Welt nachdenken, muss man über Interessen und Macht sprechen, nicht über den „Cyberspace“ der 1980er.

Die Bedeutungsmacht der Informationstechnologien ist immens. Sie reicht vom privaten Alltag bis in die Weltpolitik. Um zu einem angemessenen Umgang mit ihnen zu gelangen, reichen technische, juristische oder moralphilosophische Kenntnisse allein nicht aus. Vielmehr gilt es, technische Expertise mit der politisch-gesellschaftlichen Dimension zu verknüpfen.

Die Akademie für Politische Bildung und die Gesellschaft für Informatik eröffnen durch diese Tagung einen Diskussionsraum, in dem sich Informatiker und Nicht-Informatiker über die Selbstbestimmung im Informationszeitalter verständigen. Ziel ist es, einerseits Nichtinformatikern ein besseres Verständnis der Materie zu vermitteln, andererseits mit Informatikern

über deren gesellschaftliche Verantwortung zu diskutieren. Neben Vorträgen und Diskussionen werden einzelne Fragestellungen in Workshops vertieft.

Wir laden Sie herzlich zu unseren Diskussionen nach Tutzing ein.

Den Einladungs-Flyer finden Sie auf den Seiten der Regionalgruppe München der GI, das Anmeldungsformular stellt die Akademie für Politische Bildung Tutzing bereit.

Thomas Kittel & Carsten Trinitis

Eine Firma aus Bayern entwickelt Kamerasysteme und Software zur Videoüberwachung von öffentlichen Plätzen. Durch eine neue Funktion soll es dem System jetzt auch unter Zuhilfenahme von mehreren Mikrofonen möglich sein, verschiedene Geräusche (z. B. Schüsse) an einem Ort genau lokalisieren zu können. Dazu werden durch die Mikrofone aufgenommenen Daten auch aufgezeichnet.

Die Daten sind dabei so gut, dass sich daraus recht einfach einzelne Konversationen extrahieren lassen. Es ist nun in Echtzeit möglich, über Gesichtserkennung und eine Anfrage bei Facebook festzustellen, wer auf einem Überwachungsvideo zu sehen ist, und automatisch zu extrahieren, was die Person sagt.

Obwohl sich die Mitarbeiter der Entwicklungsfirma der Konsequenzen auf die Privatsphäre der Beobachteten bewusst sind, halten sie die Technik doch für einen wichtigen Baustein in der Verbrechensbekämpfung, da sie annehmen, dass potentielle Kriminelle innerhalb des mit Kameras ausgestatteten Bereiches abgeschreckt werden.

Aus diesem Grund bewerben Sie ihr System auch als Videoschutzsystem.

Mitarbeiter Bernd ist sich zwar im Klaren, dass durch die neue Technik nicht nur die Bewegungsprofile der Menschen gespeichert werden, sondern auch deren Konversationen für 30 Tage aufbewahrt werden. Er kann sich jedoch nicht vorstellen, dass jemand diese Daten für niedere Zwecke missbrauchen könnte. Außerdem, so denkt er, ist die Firma ja ohnehin noch so klein, dass sich niemand für die erhobenen Daten interessieren würde.

Daher, und weil das Budget für das Systembeschränkt ist, setzt er die entsprechenden Server und Datenbanksysteme, auf denen die sensiblen Daten gespeichert werden sollen, selbst auf, ohne sich vorher imDetail mit dem Thema Datensicherheit zu beschäftigen.

Nach einer 18-monatigen Testphase an zwei zentralen Plätzen und in den öffentlichen Verkehrsmitteln der Stadt soll das neue audiovisuelle Überwachungssystem nun flächendeckend in der Stadt eingesetzt werden.

Politik wie Exekutive sprechen von einem wichtigem System, das die Verbrechensrate in der Stadt bereits gesenkt hat und mit Hilfe der neuen Technik weiter senken kann (,,Unsere Erfolge geben uns recht!“). Obwohl viele Bürger der Stadt amAnfang sehr misstrauisch waren, da sie nun flächendeckend überwacht werden und sogar all ihre Konversationen gespeichert werden, haben sich die meisten doch schnell an das System gewöhnt und fühlen sichmit dem System sehr sicher.

An einem lauen Sommerabend, nach dem Ende der Testphase, fahren zwei Journalisten aus dem Ausland mit dem Bus durch das Stadtzentrum. Sie beobachten durch das Fenster, wie ein einzelner Mann rückwärts aus einem Lokal auf die Straße stolpert. Dem Mann folgen unvermittelt zwei weitere Personen mit kräftiger Statur, die den am Boden liegenden attackieren.

Die Touristen beobachten auch, dass sich umstehende Passanten, anstatt einzugreifen, zurückziehen und das Geschehen aus sicherer Entfernung beobachten, während die Täter weiterhin auf das blutend am Boden liegende Opfer einschlagen. Unter den Passanten befindet sich auch Peter, der davon ausgeht, dass die Täter problemlos mit Hilfe der Audio- und Videoaufzeichnungen identifiziert und überführt werden können.

Peter unterlässt es demnach, selbst einzugreifen, da er die Gefährdung seiner Person als unnötig einschätzt.

Die Touristen im Bus bitten indes den Busfahrer, einen Notruf abzusetzen und anzuhalten, um sie aus dem Bus zu lassen, damit sie in der Situation einschreiten können. Der Busfahrer entgegnet jedoch nur: ,,Macht Euch keine Gedanken, das ist alles auf Video. Sie werden die Täter schon finden“. Eine weitere im Bus sitzende Passantin schreit die Touristen noch an: ,,Wollt Ihr Euch umbringen, die machen doch vor Euch keinen Halt“. Im Vorbeifahren sehen sie noch den regungslosenKörper des Opfers in seinem eigenen Blut liegen.

Nach dem Vorfall wird der Polizist Karl beauftragt, die Videodaten zu sichten und herauszufinden, was genau an besagtem Abend passiert ist, und um wen es sich bei den Tätern handelt. Zuerst befragt der Polizist einige Passanten, darunter auch Peter, dessen Kontaktdaten direkt nach dem Vorfall durch eine Funkzellenabfrage ermittelt und welcher daher in Folge automatisch vorgeladen wurde. Die meisten Zeugen können sich jedoch nur noch sehr vage an den Vorfall erinnern. Sie haben das Ereignis schon verdrängt in der Annahme, dass das Geschehene doch bereits auf Video aufgezeichnet wurde. Daraufhin beantragt Karl Einsicht in die Audio- und Videoaufnahmen des Tatortes. Nach ca. zwei Wochen erfährt er jedoch, dass die Kameras an besagtem Ort zum Tatzeitpunkt anscheinend defekt waren. Aus den Tonaufnahmen kann er jedoch entnehmen, dass das Opfer in dem Lokal schon längere Zeit von den Tätern bedroht wurde. Aufgrund der fehlenden Videoaufnahmen verläuft die Ermittlung jedoch nach kurzer Zeit im Sand.

Wieder zu Hause angekommen, schreiben die beiden Journalisten einen Artikel über Zivilcourage in Deutschland, der sowohl in einer großen Zeitung als auch im Internetportal der Zeitung veröffentlicht wird. In den sozialen Medien entsteht schnell eine Diskussion über den Vorfall, der dazu führt, dass der Vorgang auch in den klassischen Medien tiefer beleuchtet wird. Es wird deutlich, dass die gefühlte Sicherheit in Wahrheit zu einer großen Unsicherheit und Gleichgültigkeit führt, da sich niemand mehr selbst in der Verantwortung sieht. Nach genauerer Analyse wird auch klar, dass sich das Verbrechen nur von den großen Plätzen an andere, nicht überwachte Orte verlagert hat. Insbesondere ist das Verbrechen an einigen dieser Orte mittlerweile so schlimm, dass sich die Bürger nicht mehr in diese Stadtviertel trauen. Auch die Polizei hat Schwierigkeiten, an den neuen Verbrechensherden die Kontrolle zu behalten.

In der Folge besteht auch großes mediales Interesse an den Entwicklern des Überwachungssystems. Diese werden sich jedoch immer mehr der Schwächen des Einsatzes der Technik bewusst. Durch ihre Technik, die die Stadt eigentlich sicherermachen sollte, ist jetzt mindestens eine Person verstorben. Bernd, der Zweifel am zufälligen Ausfall der Kamerasysteme hat, durchsucht insgeheim noch einmal die Logdateien der Datenbank und bemerkt einige Zugriffe auf die Datenbank. Könnte es sein, dass jemand die Daten gezielt gelöscht hat? Da dies jedoch auf seinen eigenen Fehler beim Design der Datenbank und der entsprechenden Zugriffsrechte zurückfallen würde, beschließt er den Fund für sich zu behalten.

Insgeheim hofft er, dass sich die mediale Aufmerksamkeit bald wieder legen wird.

Fragen

Sollte die Technik als Allheilmittel zur Lösung gesellschaftlicher Probleme gesehenwerden?

- Wie ist mit der Datenmenge der überwachten Bevölkerung umzugehen?

- Welche Gefahren ergeben sich dabei?

- Welche Konsequenzen sollte Bernd nach seinem Fund eigentlich ziehen?

- Sollte er trotz des fehlenden Budgets seine private Zeit in das Projekt stecken? Soll er die Flucht nach vorne antreten und die Presse kontaktieren?

- Wer sollte Zugriff auf die erfassten Daten bekommen? Aufgrund welcher (richterlichen) Vorbehalte?

- Machen sich die Passanten aufgrund der unterlassenen Hilfeleistung strafbar?

- Hat sich dieVerantwortung von der Zivilgesellschaft zu den Überwachern verlagert?

- Kann überhaupt noch irgend jemand zur Verantwortung gezogen werden, wenn alles der Technik überlassenwird?

Erschienen im Informatik Spektrum 39(1), 2016, S. 82-84

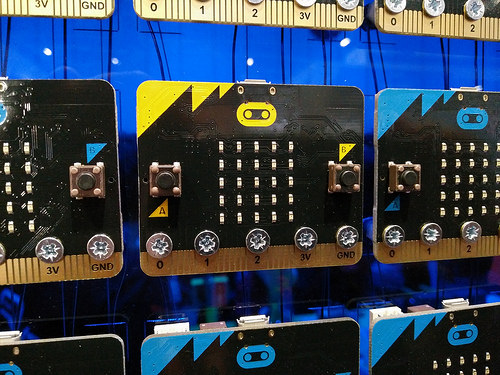

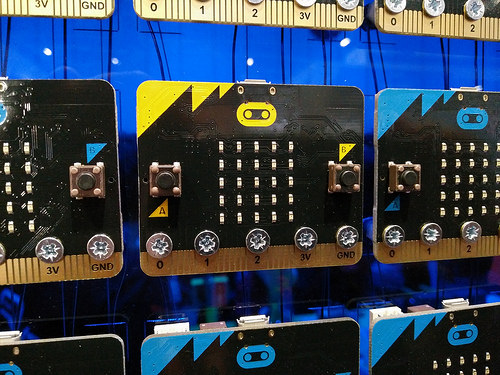

Für die FAZ habe ich mir ein paar Gedanken zum Informatik-Studium, zur Ausbildung von Schülern und zum micro:bit-Projekt der BBC gemacht:

Wenn man ehrlich auf die bundesdeutsche MINT-Realität an Schulen blickt, wird sowohl Informatik als auch Technik de facto kaum unterrichtet, erst recht zu wenig mit spannenden Projekten, die das Zeug hätten, mehr Studenten in die technischen Fächer der Universitäten zu locken. Vielerorts wird allen Ernstes in den Schulen nur der Umgang mit gängiger Office-Software gelehrt, nicht aber grundlegendes Informatik-Verständnis.

Mich hat das micro:bit-Projekt auch deswegen begeistert, weil es auf so einfache Weise Zugang zu informatischen Welten eröffnet. Wer ein wenig mehr über micro:bit erfahren möchte, das die BBC in Zusammenarbeit mit Google, Microsoft, Samsung, der British Computing Society und weiteren Unterstützern auf den Weg gebracht hat: hier entlang, mit weiteren Links. Mich hat das micro:bit-Projekt auch deswegen begeistert, weil es auf so einfache Weise Zugang zu informatischen Welten eröffnet. Wer ein wenig mehr über micro:bit erfahren möchte, das die BBC in Zusammenarbeit mit Google, Microsoft, Samsung, der British Computing Society und weiteren Unterstützern auf den Weg gebracht hat: hier entlang, mit weiteren Links.

Es geht mir in dem Artikel auch um die Wahrnehmung der universitären Informatik und darum, ob ein angehender Informatiker im Studium eigentlich angeleitet wird, technische Projekte und Entwicklungen kritisch zu beurteilen, um sein Handeln später in verantwortungsvoller Weise ausführen zu können. Es wird wohl wenig überraschen, dass ich finde, dass das im Studium zu kurz kommt.

Bildlizenz: CC BY-SA 2.0, via flickr/Les Pounder

Im Fallbeispiel „Data Mining für Public Health“ haben wir rumgesponnen, was die Krankenkassen so alles mit unsere Daten anstellen können. Die Apotheker haben sich wohl inspirieren lasen: Weitergabe von Rezeptdaten.

Christina Class & Debora Weber-Wulff

Sie haben sich seit Jahren darauf vorbereitet. Visionen der 50er Jahre eines selbstfahrenden Autos werden wirklich wahr. Galene, haben sie ihre Entwicklung, das selbstfahrende Auto, getauft, und es ist auf dem Testgelände fantastisch gefahren. Auch bei Testfahrten in Amerika – dazu musste Galene verschifft werden – lief alles prima. In den USA gibt es nicht so viele Vorschriften, und es gibt unendlich weite Straßen, auf denen man gute Sicht hat und viel ausprobieren kann.

In Deutschland war alles komplizierter und es hat länger gedauert, um die Genehmigung für Testfahrten im Straßenverkehr zu erhalten, aber diese lag nun vor. Morgen war die Presse für die breit angekündigte „Jungfernfahrt“ eingeladen. Jürgen, einer der stolzen „Eltern“ von Galene, will sie nach Absprache mit dem Teamleiter erst einmal so ohne Pressetrubel auf der geplanten Strecke fahren lassen, um sicher zu sein, dass alles klappt. Als guter Ingenieur hat er die Strecke mit Bedacht ausgewählt. Es ist Sonntagnachmittag, da ist auf diesen Straßen wenig Verkehr. Und er selber sitzt ja auch hinterm Steuer undkannnotfalls eingreifen, wenn etwas sein sollte. Er ist sich sicher, dass er nicht auffallen und evtl. andere Autofahrer oder Passanten irritieren wird.

Er gibt das Ziel mündlich im Sprachcomputer ein. Galene bestätigt das Ziel, und berechnet den Weg unter Berücksichtigung der aktuellen Verkehrsnachrichten, den bekannten Baustellen und der Wettervorhersage. Alles ist ruhig, keine Baustellen im Weg, kein Regen oder Nebel aber etwas Wind: ein sonniger Herbsttag und der perfekte Tag für eine erste Testfahrt!

Jürgen genießt die Fahrt auf der ihm wohl bekannten Strecke. Es ist schon ein tolles Gefühl, sich fahren zu lassen, obwohl es immer noch sehr ungewohnt ist, kein Gas zu geben, nicht zu bremsen und nicht zu steuern. Galene fädelt auf der Stadtautobahn perfekt ein, überholt einen Oldtimer, und fährt an der nächste Ausfahrt wieder raus, sanft an der Ampel anhaltend. Galene hält dabei immer genügend Abstand zum Vordermann ein. Die Steuerung ist so präzise, dass sie bis auf einen Zentimeter heranfahren könnte, um hinter dem Vordermann anzuhalten. Aber das macht andere Verkehrsteilnehmer unnötig nervös, und so haben sie Galene auf 40 cm Abstand programmiert.

Jürgen würde gerne mit seinem Handy filmen, wie er die grüne Welle bekommt und dann an der dritten Ampel links abbiegt – er war sich nicht ganz sicher, ob Galene das alles korrekt berechnen würde, aber es hat perfekt geklappt. Da er für die anderen Autofahrer den Anschein aufrecht halten muss als fahre er das Auto, kann er schlecht mit dem Handy filmen. Sie kommen in ein neueres Wohnviertel und Galene bremst auf die vorgeschriebenen 30 km/h runter. Links ist eine Schule, auf beiden Seiten befinden sich Bushaltestellen für die Schulbusse. Sie haben viel Zeit darauf verwendet, Galene auf solche Verkehrssituationen vorzubereiten.

Aber zum Glück sind je gerade Herbstferien. Rechts kommen sie an einem Park mit großen Rasenflächen vorbei. Er hört Kindergeschrei und blickt nach rechts. Jürgen sieht Hunde tollen, bunte Bälle auf der Wiese und noch buntere Drachen in der Luft fliegen. Sie bewegen sich mit dem Wind in seine Richtung. Jürgen greift instinktiv zum Steuer, er ist sich bewusst, dass Kinder beim Spielen nicht auf den Verkehr achten.

Gerade zu Beginn hat er das öfter erlebt: er wurde nervös, griff zum Steuer und drückte den Knopf, um die Kontrolle zu übernehmen. Aber es war nie notwendig und so lernte er, entspannt zu bleiben und Galene die Kontrolle zu überlassen. Und plötzlich passiert es: Ein Kind rennt mit seinem Drachen zwischen zwei parkenden Autos auf die Straße und wird von Galene erfasst. Es stürzt bewusstlos zu Boden.

Galene bremst sofort, da die Sensoren den Aufprall erfasst haben. Jürgen zieht gleichzeitig den Nothaltknopf. Galene steht, der Warnblinker ist eingeschaltet. Jürgen steigt aus und rennt zum Kind, die Mutter kommt dazu und schreit Jürgen an. Eine junge Frau steigt aus dem Auto, das hinter Jürgen gefahren ist und leistet erste Hilfe. Sie sagt, sie sei Krankenschwester.

Ein Hundebesitzer aus dem Park hat schon den Notruf abgesetzt, der Krankenwagen ist schnell da und fährt das Kind mit seiner Mutter mit Blaulicht in das nächstgelegene Krankenhaus. Auch die Polizei ist da, um den Unfall aufzunehmen. Jürgen steht ziemlich unter Schock. Die junge Frau, die erste Hilfe geleistet hat, wendet sich sofort an die Polizei, noch bevor diese Jürgen befragen kann. Ihr Name sei Sabine und sie

sei hinter dem Unfallauto gefahren. Ihrer Meinung nach sei es zu schnell gefahren. Sie selber sei viel langsamer als 30 gefahren, bei all dem Kindergeschrei aus dem Park, den Hunden,

Bällen und Drachen musste man ja mit sowas rechnen!

Die Polizisten bitten Jürgen, sich auszuweisen. Er gibt ihnen den Personalausweis, Führerschein, sowie die Betriebserlaubnis für Testfahrten. Die Polizisten sind erstaunt und stellen einige Fragen zum Auto, sie sind neugierig. Da es sich um Testfahrten handelt und das Auto nicht generell zugelassen ist, wollen sie Galene in jedem Fall abschleppen lassen, umgenauere Untersuchungen anzustellen, insbesondere auch um Daten für die Auswertung auszulesen. Jürgen weiß, dass Galene korrekt gefahren ist, aber der Vorwurf der Zeugin Sabine macht ihn trotzdem nachdenklich. Die Probefahrt und Pressekonferenz am nächsten Nachmittag sind gefährdet. Ein PR Desaster, vor allen Dingen nach diesem Unfall!

Fragen

– Das Auto hatte eine offizielle Betriebserlaubnis für Testfahrten. War es in Ordnung, vor der offiziellen Probefahrt, eine Testfahrt durchzuführen?

– Flugzeugpiloten müssen immer wieder ein Training absolvieren, um im Notfall schnell genug zu reagieren und die Kontrolle vom Autopiloten zu übernehmen. Wird ein solches Training auch bei selbstfahrenden Autos notwendig sein? Durfte Jürgen sich während der Probefahrt so entspannt zurücklehnen?

– Als Jürgen die Kinder im Park sah, griff er instinktiv zum Lenkrad. Müsste er als Fahrer in einer solchen Situation, in der er mit auf die Straße rennenden Kindern rechnete, die Kontrolle über das Fahrzeug übernehmen?

– Galene fuhr die vorgeschriebene Geschwindigkeit von 30 km/h. Die Zeugin machte denVorwurf, das sei bei den vielen Kindern im Park zu schnell gewesen. Inwiefern kann und soll eine Anpassung der Geschwindigkeit an Gegebenheiten, die neben der Straße stattfinden, in Algorithmen abgebildet werden?

– Es kann immer wieder zu Unfällen kommen, weil Unvorhergesehenes passiert: ein Kind rennt auf die Straße, Wildwechsel, ein Ast stürzt auf die Fahrbahn. Oft ist es das schnelle Reaktionsvermögen des Fahrers oder ein instinktives Zögern, das Schlimmeres verhindert. Sollten Algorithmen versuchen, eine Art Instinkt abzubilden? Inwiefern können selbstlernende Systeme hilfreich sein?

– Manchmal kommt es auch zu Auffahrunfällen, wenn sich ein Fahrer „zu korrekt“ verhält, z. B. an einer viel befahrene Straße bei gelb an der Ampel hält oder bei einer unübersichtlichen Kurve nach einer Schnellstraßenausfahrt die Geschwindigkeitsbegrenzung exakt einhält. Sollten man in selbstfahrende Autos, die darauf programmiert sind, sich so korrekt zu verhalten, eine gewisse Unschärfe im Umgang mit Verkehrsregeln einbauen, je nachdem wie sich die vorausfahrenden bzw. hinterherfahrenden Autos verhalten?

– Es wird kaum möglich sein, in Tests alle möglichen Fälle abzudecken. Daher kann es vorkommen, dass die Software von selbstfahrenden Autos falsch reagiert.Wer ist dann zur Verantwortung zu ziehen? Die Entwickler? Die Hersteller? Der Fahrer, der für den Fall der Fälle im Auto sitzt? Oder werden wir solche Fälle hinnehmen, da die Autos in anderen Fällen größere Sicherheit versprechen? Wo können dann aber die Grenzen gezogen werden?

– Wie und wann werden Software Updates bei selbstfahrenden Autos durchgeführt? Nur in der Werkstatt, oder wenn das Auto gerade steht? Wer kontrolliert, ob und wann ein Update durchgeführt werden soll? Und wie sieht die Situation aus, wenn ein Unfall durch ein nicht durchgeführtes Update wahrscheinlich hätte verhindert werden können? Wer übernimmt dann die Verantwortung?

Erschienen in Informatik Spektrum 38(6), 2015, S. 575–577.

|

|

Seit der Diskussion um Donald Trumps Gattin Melania Trump und ihre Rede beim Nominierungsparteitag der Republikaner, die in Teilen von einer Rede von Michelle Obama abgekupfert war, wird in den Vereinigten Staaten Plagiarismus wieder öffentlich diskutiert. Argumentativ erinnern viele Wortmeldungen an die deutsche Diskussion um die Plagiate in den Doktorarbeiten von Bildungsministerin Annette Schavan und Verteidigungsministerin Ursula von der Leyen, obwohl natürlich eine politische Rede nicht mit einer akademischen Qualifizierungsarbeit zu vergleichen ist. Denn selbstverständlich ist von angehenden Promovierten ein anderes Wissen darum zu erwarten, wie man wissenschaftlich sauber arbeitet.

Seit der Diskussion um Donald Trumps Gattin Melania Trump und ihre Rede beim Nominierungsparteitag der Republikaner, die in Teilen von einer Rede von Michelle Obama abgekupfert war, wird in den Vereinigten Staaten Plagiarismus wieder öffentlich diskutiert. Argumentativ erinnern viele Wortmeldungen an die deutsche Diskussion um die Plagiate in den Doktorarbeiten von Bildungsministerin Annette Schavan und Verteidigungsministerin Ursula von der Leyen, obwohl natürlich eine politische Rede nicht mit einer akademischen Qualifizierungsarbeit zu vergleichen ist. Denn selbstverständlich ist von angehenden Promovierten ein anderes Wissen darum zu erwarten, wie man wissenschaftlich sauber arbeitet.

Beiträge als RSS abonnieren

Beiträge als RSS abonnieren

Kommentare